公開日:2026/3/24

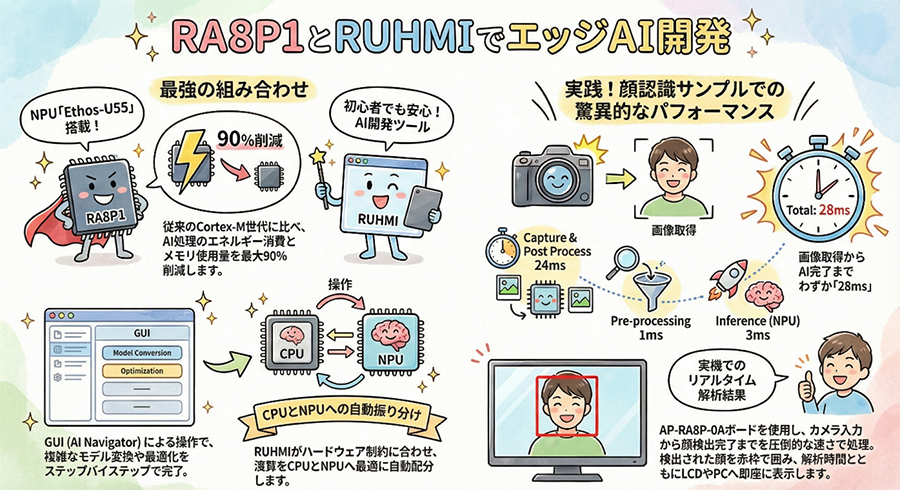

近年のエッジAI市場規模はさらに拡大しています。しかし、メモリや電力の限られた小さいマイコンでAIモデルを動作させるのは、開発者にとって至難の業です。そこで登場したのが、NPUとCPUの両方を搭載したRA8P1です。RA8P1を用いれば、低消費電力かつ高速なAI処理が可能となります。

今回は、技術コラム Vol.31「NPU×1GHzで圧倒的性能 ! RA8P1登場」の続きとして、RA8P1の目玉機能であるAI機能およびその処理を支援するAI開発ツールキットについて、ご紹介させていただきます!

- Neural Processing Unit(NPU)の概要

- Robust Unified Heterogenous Model Integration(RUHMI)

- サンプルプログラムの紹介

- まとめ

1. Neural Processing Unit(NPU)の概要

(1) NPUとは

Neural Processing Unit(以下、NPU)はニューラルネットワークの推論に特化したプロセッサで、従来のCPUやGPUに比べて、より高速かつ省電力でAIの処理を実現します。

NPUは、行列演算や畳み込み演算など、AIアルゴリズムで頻繁に使われる計算を効率的に行う専用回路を備えています。これにより、組込み機器でもリアルタイムで高度なAI機能を利用できるようになります。

NPU自体は、すでに弊社でも技術コラム Vol.026「最新の高性能AI MPUを体験してみよう」やVol.028「組込み環境で広がるNPU×AIを体験しよう!!」で紹介したAP-RZV2-0AやNX-N947といった一部AI対応CPUボードにも搭載されています。

今回のRA8P1は、ルネサス エレクトロニクス社のArm® Cortex®-Mプロセッサ内蔵のRAシリーズとして初めてNPUを搭載し、従来の低消費電力性能とAI性能を併せ持った最新CPUとなります。

当社は、RA8P1を搭載したCPUボード「AP-RA8P-0A」を2026年1月に発売しました。

(2) Ethos-U55の概要

RA8P1では、NPUとして「Ethos-U55」を採用しています。 面積制約の厳しい組込みデバイスにおいて、機械学習(ML)の推論を加速させるマイクロNPUです。

[Ethos-U55の特長]

- 極限の効率性

Ethos-U55は、音声認識(ASR)などのMLワークロードにおいて、従来のCortex-M世代と比較してエネルギー消費を最大90%削減します。 - オフライン最適化(Optimization)

ニューラルネットワークをオフラインでコンパイル・最適化し、演算子やレイヤーの融合・並び替えを行うことで、性能向上と最大90%のメモリ削減を実現します。 - 混合精度のサポート

タスクに合わせてInt8(画像分類・物体検出など)とInt16(音声・HDR画像強化など)を使い分けることが可能です。

Ethos-U55のその他特徴に関してはArm 社の以下のサイトをご参照ください。

Ethos-U55公開ページ Ethos-U55

2. Robust Unified Heterogenous Model Integration(RUHMI)

(1) RUHMIの概要

Robust Unified Heterogenous Model Integration(以下、RUHMI)はルネサス エレクトロニクス社が無償で提供する、AIアプリケーション開発加速ツールセットです。

通常、PCやサーバで学習させたAIモデルは巨大で、そのままではマイコン上で動作しません。そこでRUHMIはルネサス エレクトロニクス社のパートナーであるEdgeCortix®社の強力なコンパイラエンジン「MERA™」を搭載し、複雑なモデルをわずか数分でリソースの限られたプロセッサに最適化した形に変換します。

[RUHMIの主な機能]

- 高度なモデル変換と量子化

TensorFlow Lite、ONNX、PyTorchといった主要なフレームワークをサポートしています。 - ヘテロジニアスへの自動対応

ハードウェアの制約に合わせて、演算をCPUとNPU(Ethos-U55など)に自動的に振り分けます。 - 組込み用Cコードの自動生成

変換されたモデルは、e2 studioなどの開発環境に直接統合できる最適化されたC/C++ソースコードとして出力されます。 - 外部メモリのサポート

内蔵SRAMのサイズを超えるような大規模なモデルでも、外部メモリ(OSPIなど)を活用して実行できる機能を備えています。

(2) AIアプリケーション統合開発環境について

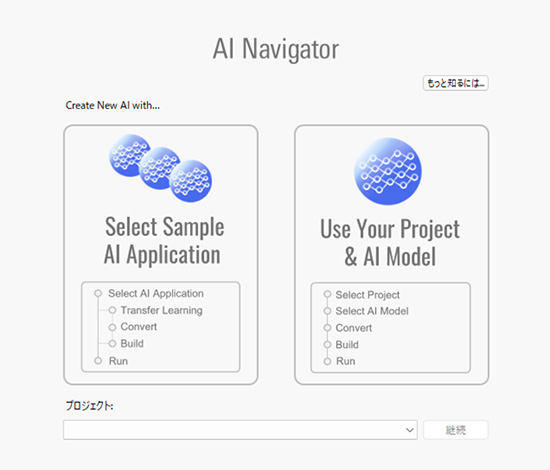

RUHMIの一環として、ルネサス エレクトロニクス社では統合開発環境e2 studioのプラグイン形式で「AI Navigator」が提供されています。AI Navigatorの最大の特長は、コマンドライン(CLI)操作に不慣れな初心者でも、GUIを通じて視覚的かつステップ・バイ・ステップで開発を進められる点にあります。モデルのインポートから実機での実行まで、一連のワークフローが統合されており、開発者はツール間の移動に煩わされることなく作業に集中できます。

AI Navigatorは、ユーザーの習熟度や目的に合わせて2つのルートが用意されています。

① サンプルアプリケーションを利用

「顔検出」や「画像分類」といった、事前学習済みモデルを含むサンプルプロジェクトを数クリックでインポートできます。まずは動くものを見てみたい、という方に最適です。

② 独自のプロジェクトとモデルを利用

ユーザー自身が作成したプロジェクトや、手元の学習済みモデル(TensorFlow Lite, ONNX, PyTorchなど)をマイコン用に変換して組み込むことができます。

RUHMI及びAI Navigatorのその他機能や特徴に関しては、ルネサス エレクトロニクス社の以下のサイトをご参照ください。

RUHMI公開ページ RUHMI

3. サンプルプログラムの紹介

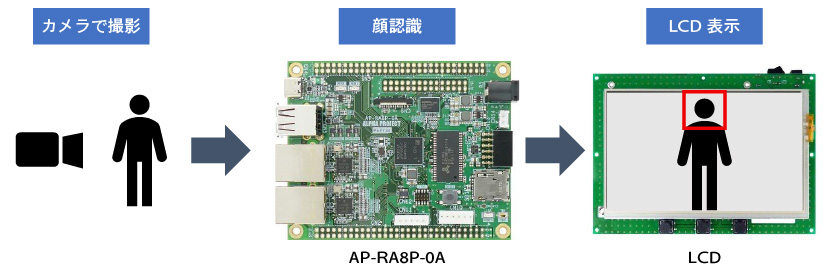

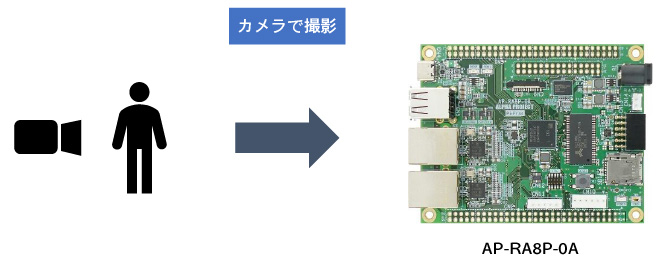

当社製品「AP-RA8P-0A」では、AIを使用した顔認識のサンプルプログラムを提供しています。

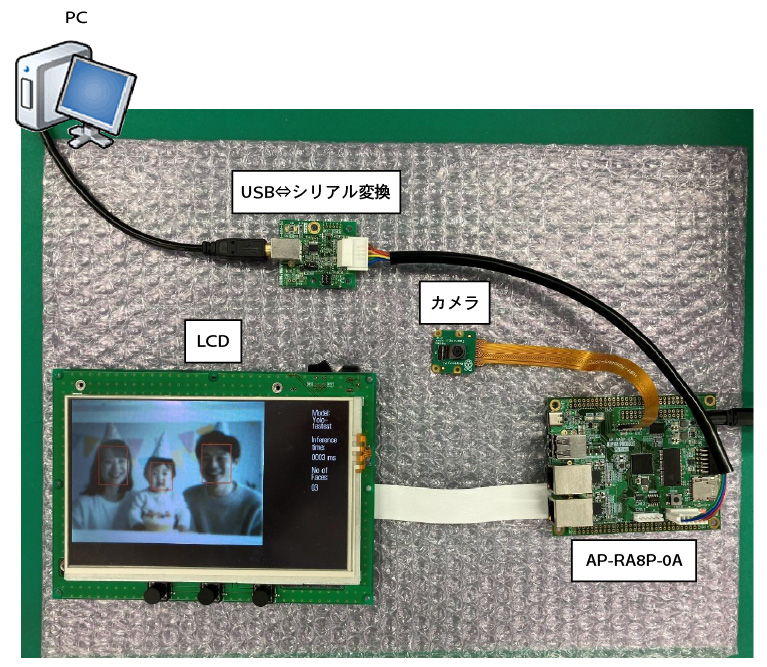

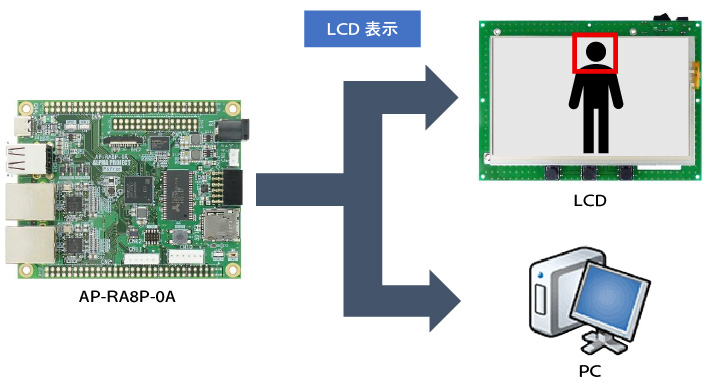

サンプルプログラムでは、カメラから画像から顔を検出し、その結果及び処理時間等をLCD及びシリアル通信経由でPCに表示します。

実際の接続例は下図です。

(1) サンプルプログラムの流れ

サンプルプログラムの流れを紹介します。

① カメラ映像の入力

カメラモジュールを使用して撮影を行い、MIPI経由で「AP-RA8P-0A」にカメラ画像を渡します。

② 入力画像データの解析

カメラ画像をRUHMI提供モデルに入力し、NPUを用いて顔の検出を行います。顔が検出された場合顔を赤枠で囲うようにカメラ画像の編集を行います。

③ 解析結果をLCD及びPCへ表示

編集完了後、編集された画像及び検出結果をLCDに表示します。また処理時間やAIの解析結果をシリアル通信経由でPCに表示します。

(2) サンプルプログラムの実行結果

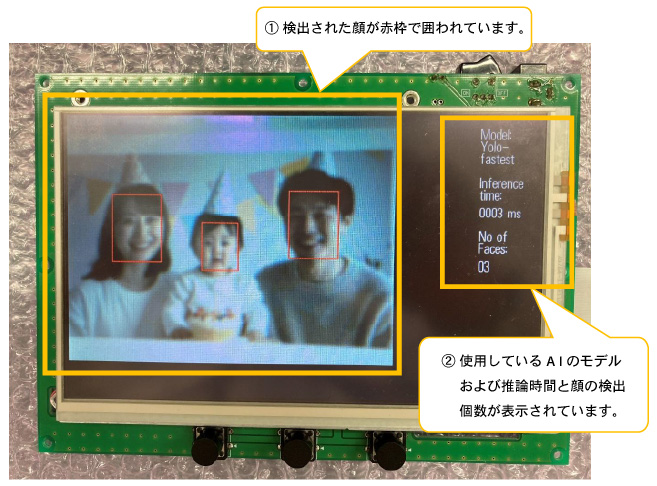

サンプルプログラムの実行結果の一例を紹介します。

① LCD側の表示結果

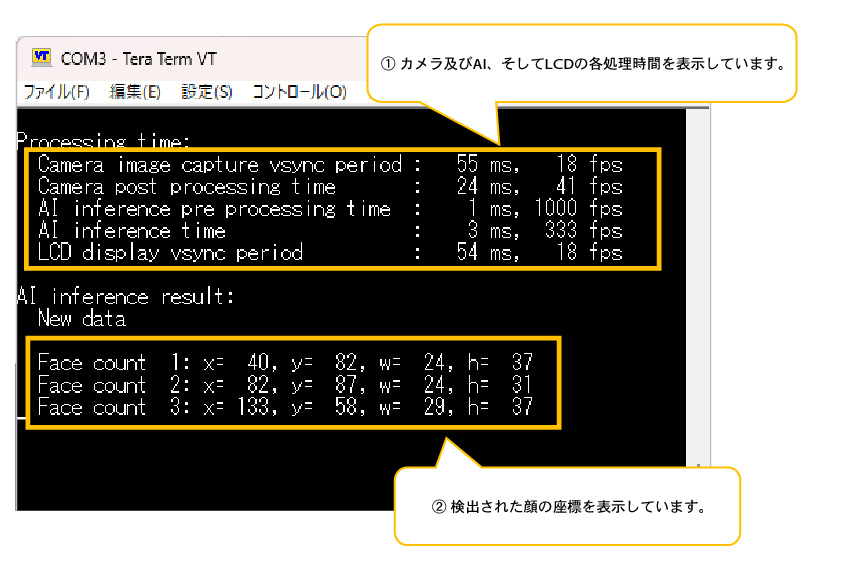

② PC側の表示結果

上記の結果では、3人家族の写真から3つの顔を検出した際の処理時間および検出時の座標を表しています。

処理時間に着目し、以下の表にまとめました。

| 項目名 | 項目名の内容 | 処理時間 |

|---|---|---|

| Camera image capture vsync period | カメラ画像の取得周期 | 55[ms] |

| Camera post processing time | カメラ画像の処理時間 | 24[ms] |

| AI inference pre processing time | AI推論用前処理時間 | 1[ms] |

| AI inference time | AI推論時間(NPU処理) | 3[ms] |

| LCD display vsync period | LCDの出力周期 | 54[ms] |

表より「カメラ画像の処理時間」から「AI推論時間(NPU処理)」までの処理時間を足すと28[ms]となります。このことから、画像を取得してからAIの処理が完了するまでに「28[ms]」と、高速で処理されていることが確認できます。

本コラムでご紹介しましたAIサンプルプログラムは「AP-RA8P-0A」のサンプルプログラムとして公開します。詳細はアプリケーションノート「AP-RA8P-0A AIサンプルプログラム解説」をご参照ください。

4. まとめ

今回は、RA8P1のAI機能及びそれを手助けするAIツール、そして当社の最新CPUボード「AP-RA8P-0A」を活用したAIサンプルプログラムのご紹介をしました。

エッジAIは近年さらに注目を集めています。今回ご紹介したサンプルプログラムとアプリケーションノートにより簡単にエッジAIを体験することができます。ご興味がございましたらぜひ当社の「AP-RA8P-0A」をお試しください。

製品のご案内

- ※ArmおよびCortexは、米国および/またはその他の地域におけるArm Limited(またはその子会社)の登録商標です。

- ※記載されている会社名、製品名は、各社の商標または登録商標です。

- ※記載の内容は改良のため、予告なく変更する場合がございます。